Creación, edición y administración de Test Case Unitario

Al hacer clic en el botón Añadir en la página principal de "Test Case Unitarios", se abrirá un formulario para crear el testcase. Para ello es necesario completar algunos campos obligatorios. A continuación, te explicamos el proceso paso a paso, incluyendo qué información debes proporcionar para evitar errores durante la creación.

-

Acceso a la sección de Test Case: Dirígete a la sección de Test Case Unitario en el menú principal de la plataforma.

-

Añadir un nuevo Test Case: Haz clic en el botón Añadir para iniciar la creación de un nuevo Test Case.

-

Rellenar los campos del formulario:

- Nombre: El nombre del test, que te ayudará a identificarlo en la lista de tests.

- Dataset: El conjunto de datos previamente guardado que contiene las respuestas con las que se hará la comparación.

- Asistente: El asistente cuyo rendimiento será evaluado.

- Versión: La versión del asistente o modelo a probar.

- Criteria: Se pueden agregar uno o más criterios para evaluar el test. Estos criterios son:

- Similarity: Introduce el porcentaje de similitud que consideras suficiente para validar el test case y selecciona el modelo para realizar la comparación (puedes elegir entre modelos de Google o Amazon).

- LLM: Seleccionas el modelo contra el que vas a realizar la comparación.

-

Guardar el nuevo modelo: Una vez que hayas completado todos los campos obligatorios, haz clic en el botón Crear y ejecutar para crear el testcase y en Cancelat si deseas salir del proceso de creación.

-

Confirmación: Si todos los campos están completos y válidos, el testcase se creará correctamente y aparecerá en la lista de modelos disponibles.

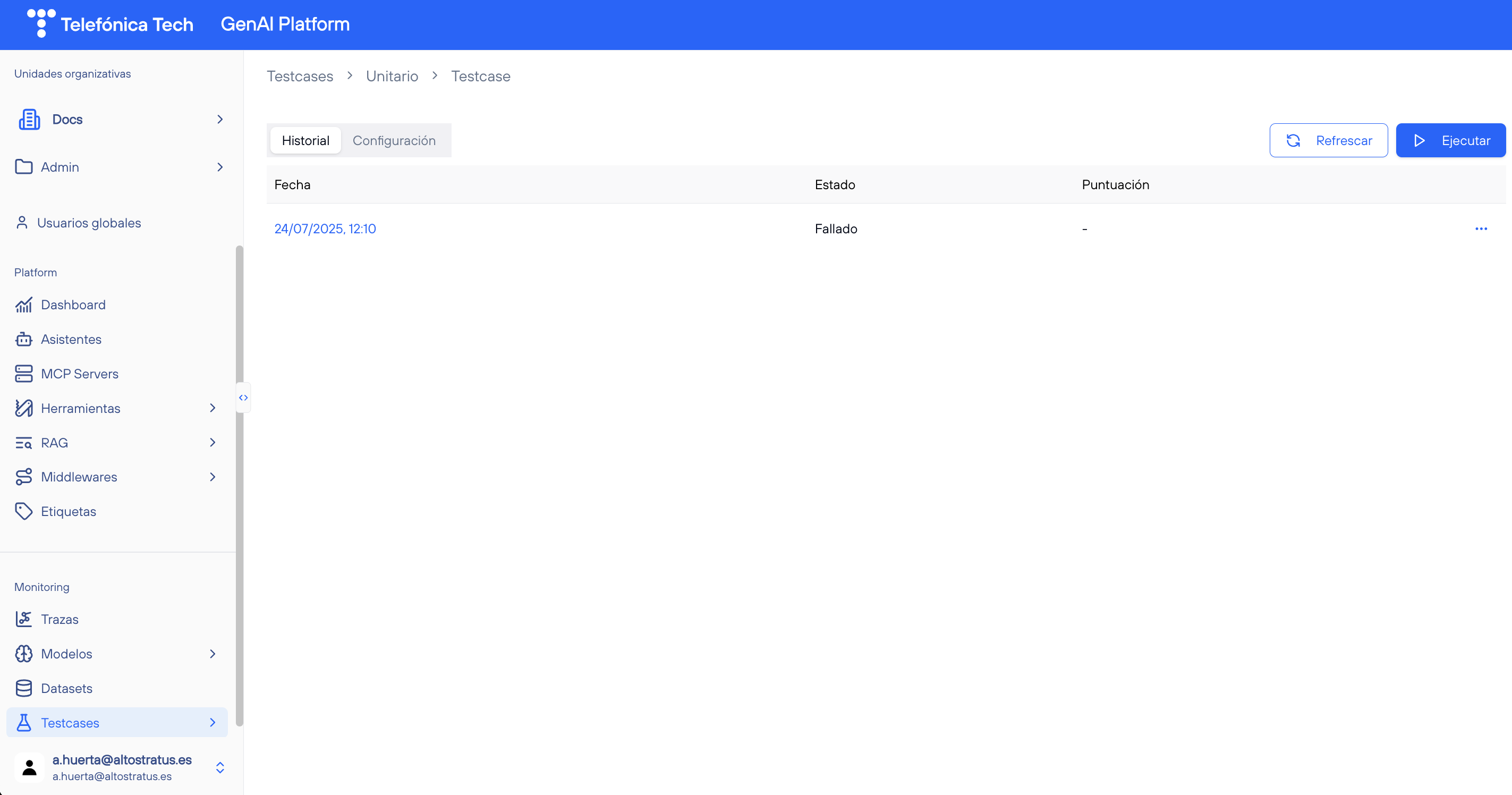

Para acceder a cada Test Case Unitario, desde la lista, haz clic en el nombre. En esta pantalla se muestra la información relevante de los Test Case ya ejecutados, permitiendo al usuario revisar los resultados y realizar nuevas acciones.

Historial

Muestra un listado con todas las ejecuciones anteriores del Test Case. Esta es la información que puedes ver:

-

Fecha y hora de la ejecución: Indicando la fecha y hora en la que se ejecutó cada uno. Al hacer clic en esta información, se accede a los detalles de esa ejecución, donde se puede revisar más a fondo los resultados específicos.

-

Estado del test: Junto a la fecha de ejecución, se indica el estado del test, que puede ser pendiente, ejecutándose o finalizado.

-

Puntuación: Este porcentaje refleja qué tan exitoso fue el test, según los criterios definidos (como "similarity" o "LLM").

-

Submenú de opciones:

- Eliminar: Permite eliminar el test case ejecutado.

Configuración

Aquí podrás modificar la configuración inical si deseas realizar ajustes antes de volver a ejecutarlo.

Refrescar

Si el Test Case aún no ha finalizado o si quieres comprobar el estado más reciente, puedes actualizar los datos con el botón "Refrescar".

Ejecutar

Si necesitas volver a correr el Test Case con la configuración actual, puedes hacer clic en "Ejecutar" para iniciar una nueva ejecución.

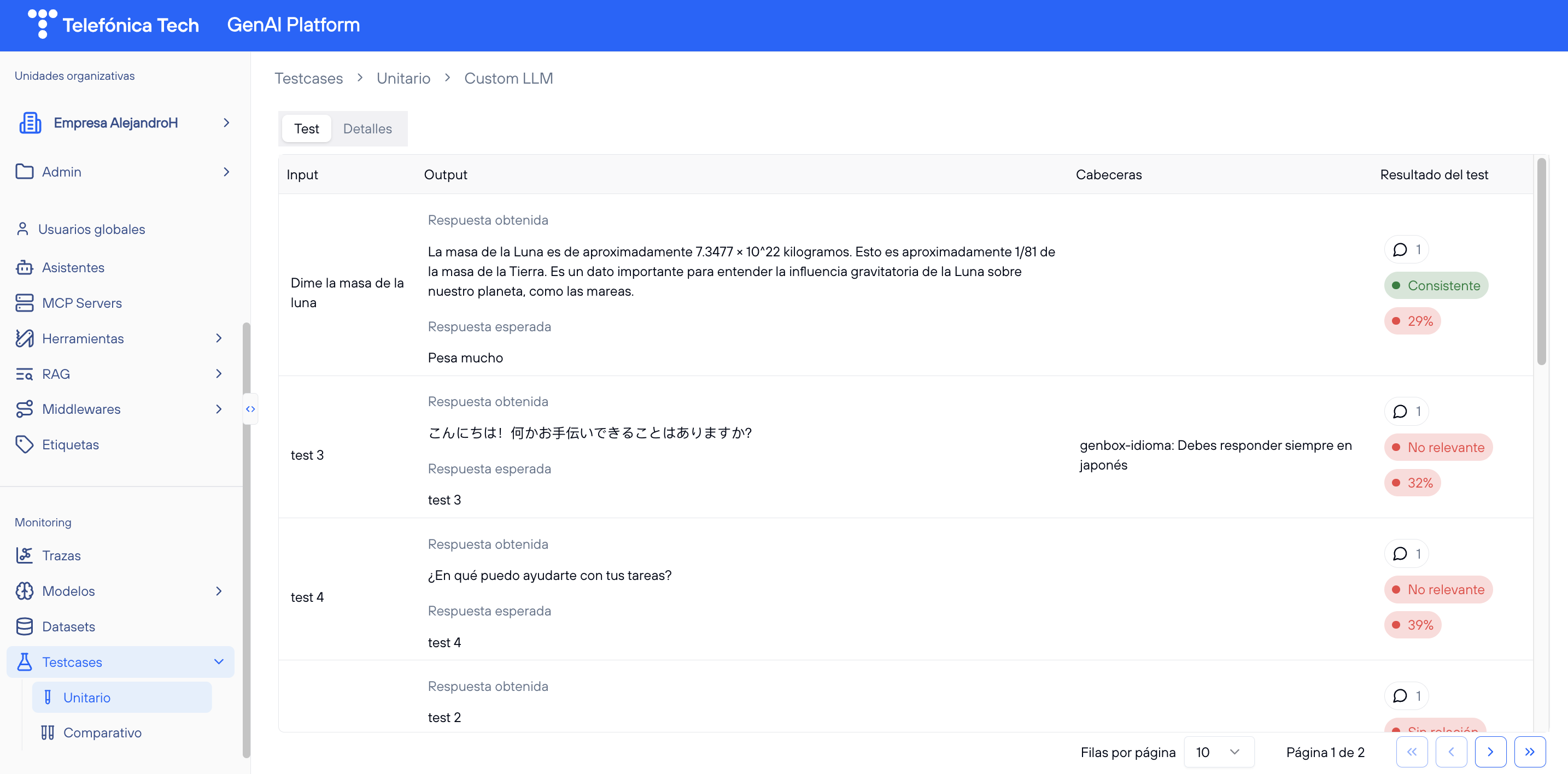

Detalles del Test Case

Al hacer clic sobre la fecha y hora de ejecución del Test Case, accedes a una vista detallada de los resultados obtenidos.

En esta vista verás las respuestas esperadas y actuales, junto con el porcentaje de similitud (en caso de haber usado el criterio SIMILARITY) o las respuestas generadas por diferentes modelos en el caso de haber usado el criterio LLM.

También podrás ver el input y output de las interacciones probadas. Cada interacción mostrará la entrada enviada y la respuesta generada por el modelo.